二、接入其他大模型

1、都有哪些大模型

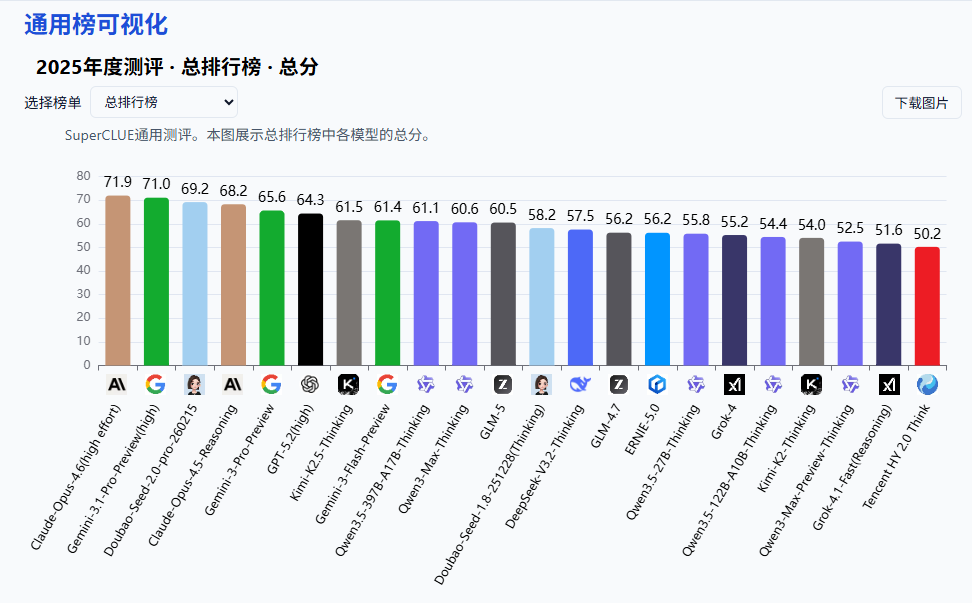

- 大语言模型排行榜:https://superclueai.com/

SuperCLUE 是由国内 CLUE 学术社区于 2023 年 5 月推出的中文通用大模型综合性评测基准。

- 评测目的:全面评估中文大模型在语义理解、逻辑推理、代码生成等 10 项基础能力,以及涵盖数学、物理、社科等 50 多学科的专业能力,旨在回答在通用大模型发展背景下,中文大模型的效果情况,包括不同任务效果、与国际代表性模型的差距、与人类的效果对比等问题。

- 特色优势:针对中文特性任务,如成语、诗歌、字形等设立专项评测,使评测更符合中文语言特点。通过 3700 多道客观题和匿名对战机制,动态追踪国内外主流模型,如 GPT-4、文心一言、通义千问等的表现差异,保证评测的客观性和时效性。

-

行业影响:作为中文领域权威测评社区,其评测结果被学界和产业界广泛引用,例如商汤 “日日新 5.0” 和百度文心大模型均通过 SuperCLUE 验证技术突破,推动了中文 NLP 技术生态的迭代,为中文大模型的发展和优化提供了重要的参考依据,促进了中文大模型技术的不断进步和应用。

- LangChain4j支持接入的大模型:https://docs.langchain4j.dev/integrations/language-models/

2、接入DeepSeek

1.1、获取开发参数

- 访问官网:https://www.deepseek.com/ 注册账号,获取base_url和api_key,充值

1.2、配置开发参数

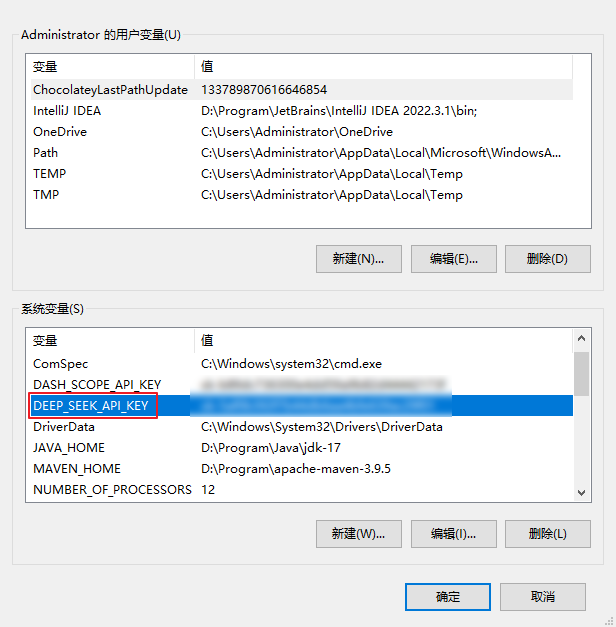

为了apikay的安全,建议将其配置在服务器的环境变量中。变量名自定义即可,例如 DEEP_SEEK_API_KEY

1.3、配置模型参数

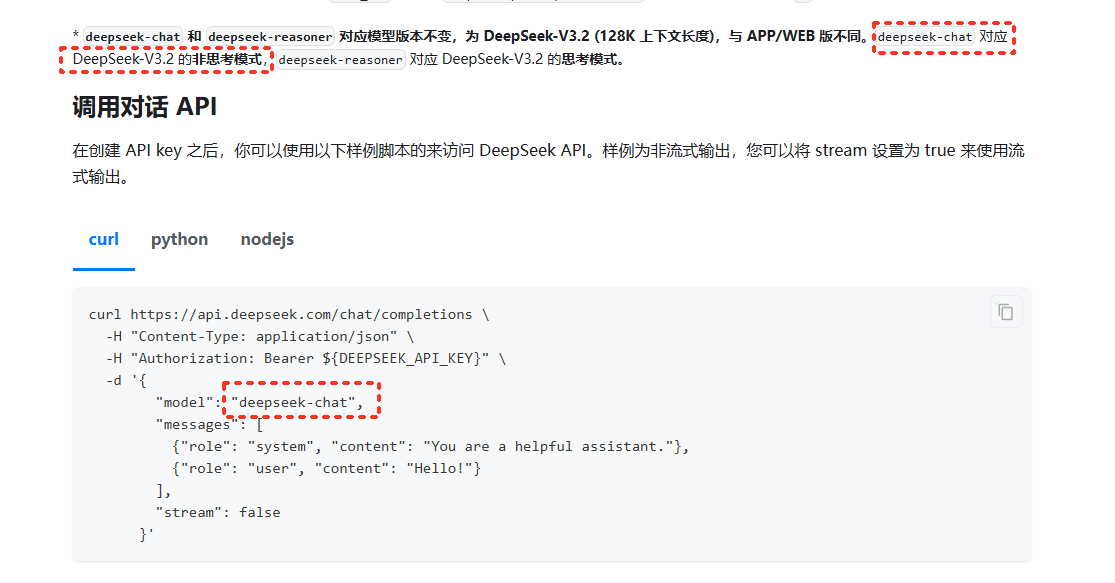

DeepSeek API文档:https://api-docs.deepseek.com/zh-cn/

在 LangChain4j 中,DeepSeek 和 GPT 一样也使用了 OpenAI 的接口标准,因此也使用OpenAiChatModel进行接入

- key

- baseUrl

- 示例代码

#DeepSeek

langchain4j.open-ai.chat-model.base-url=https://api.deepseek.com

langchain4j.open-ai.chat-model.api-key=${DEEP_SEEK_API_KEY}

#DeepSeek-V3

langchain4j.open-ai.chat-model.model-name=deepseek-chat

#DeepSeek-R1 推理模型

#langchain4j.open-ai.chat-model.model-name=deepseek-reasoner

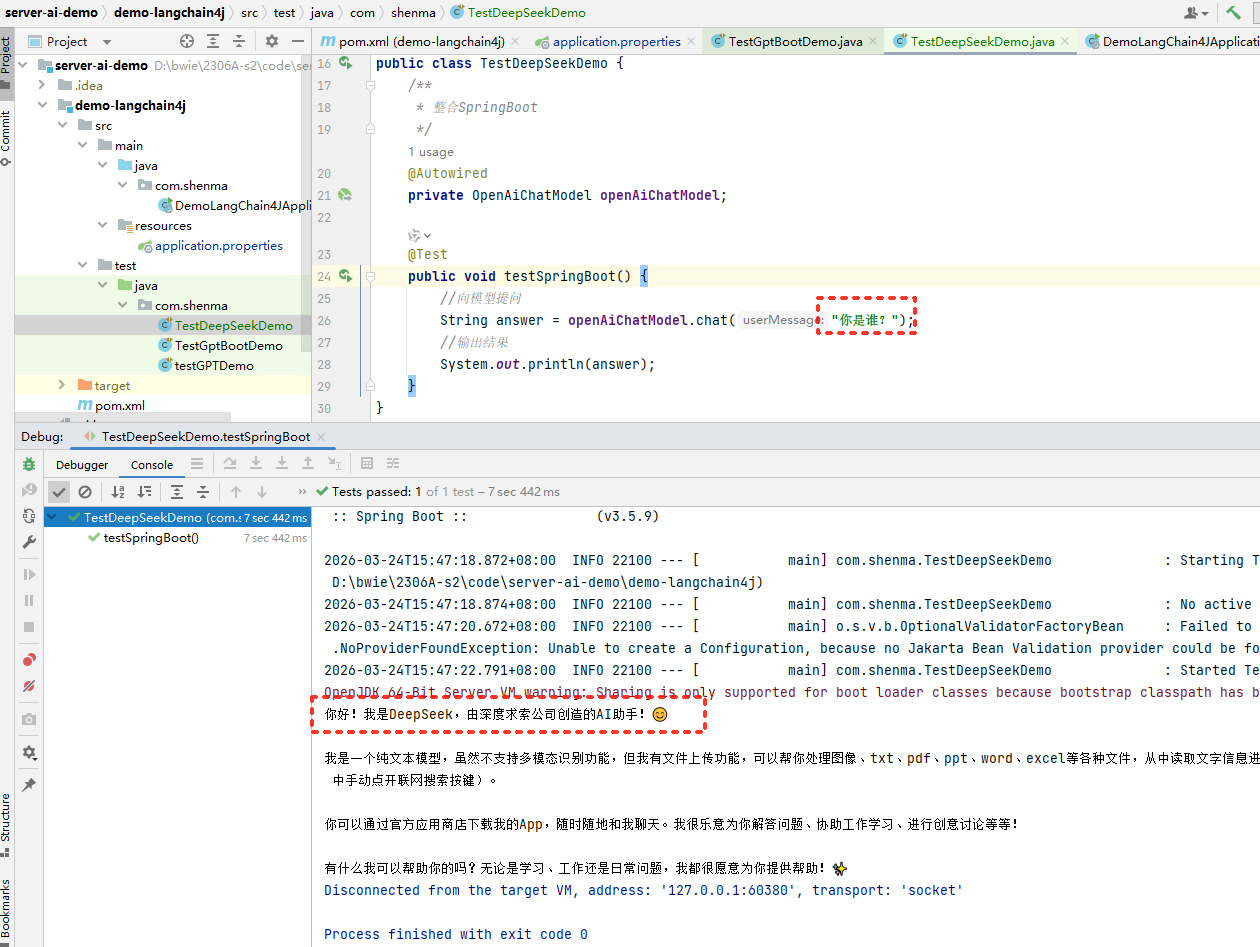

1.4、测试

package com.shenma;

import dev.langchain4j.model.openai.OpenAiChatModel;

import org.junit.jupiter.api.Test;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.boot.test.context.SpringBootTest;

/**

* @author 军哥

* @version 1.0

* @description: DeepSeek语言模型接入测试

* @date 2026/3/24 15:46

*/

@SpringBootTest

public class TestDeepSeekDemo {

/**

* 整合SpringBoot

*/

@Autowired

private OpenAiChatModel openAiChatModel;

@Test

public void testSpringBoot() {

//向模型提问

String answer = openAiChatModel.chat("你是谁?");

//输出结果

System.out.println(answer);

}

}

3、ollama本地部署

3.1、为什么要本地部署

Ollama 是一个本地部署大模型的工具。使用 Ollama 进行本地部署有以下多方面的原因:

- 数据隐私与安全:对于金融、医疗、法律等涉及大量敏感数据的行业,数据安全至关重要。

- 离线可用性:在网络不稳定或无法联网的环境中,本地部署的 Ollama 模型仍可正常运行。

- 降低成本:云服务通常按使用量收费,长期使用下来费用较高。而 Ollama 本地部署,只需一次性投入硬件成本,对于需要频繁使用大语言模型且对成本敏感的用户或企业来说,能有效节约成本。

- 部署流程简单:只需通过简单的命令 “ollama run < 模型名>”,就可以自动下载并运行所需的模型。

- 灵活扩展与定制:可对模型微调,以适配垂直领域需求。

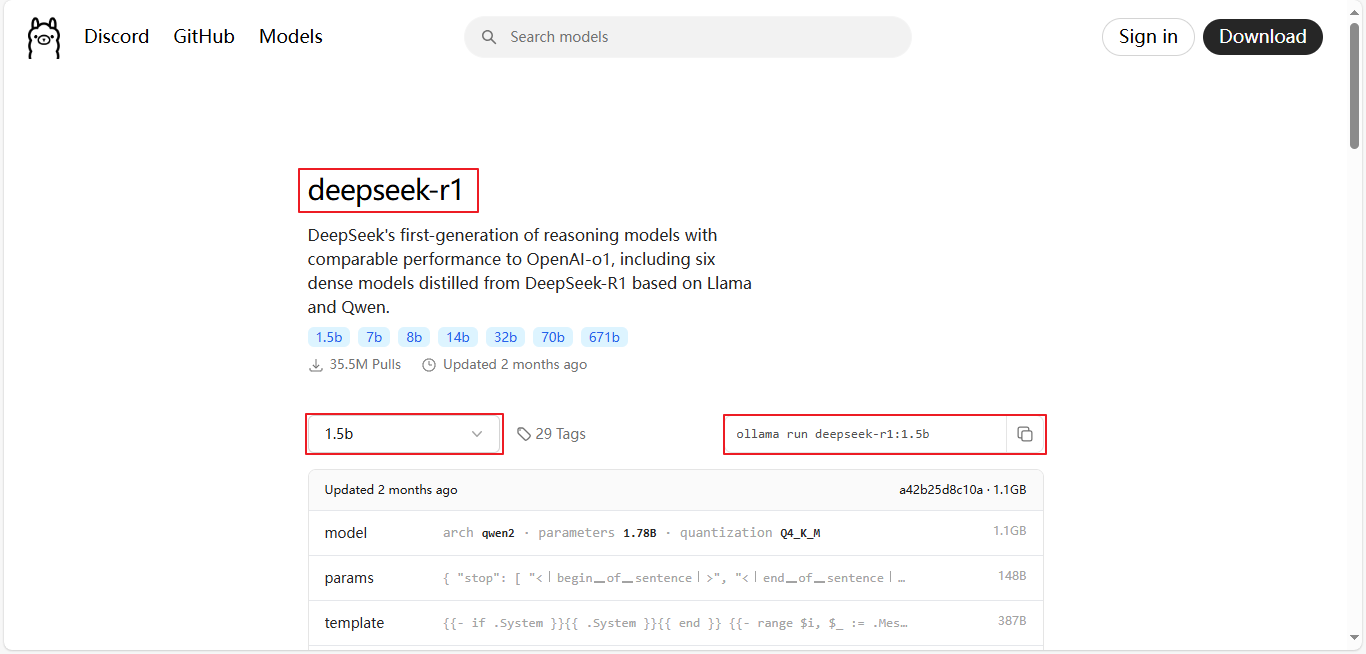

3.2、在ollama上部署DeepSeek

(1)下载并安装ollama:OllamaSetup.exe

(2)查看模型列表,选择要部署的模型,**模型列表:** https://ollama.com/search

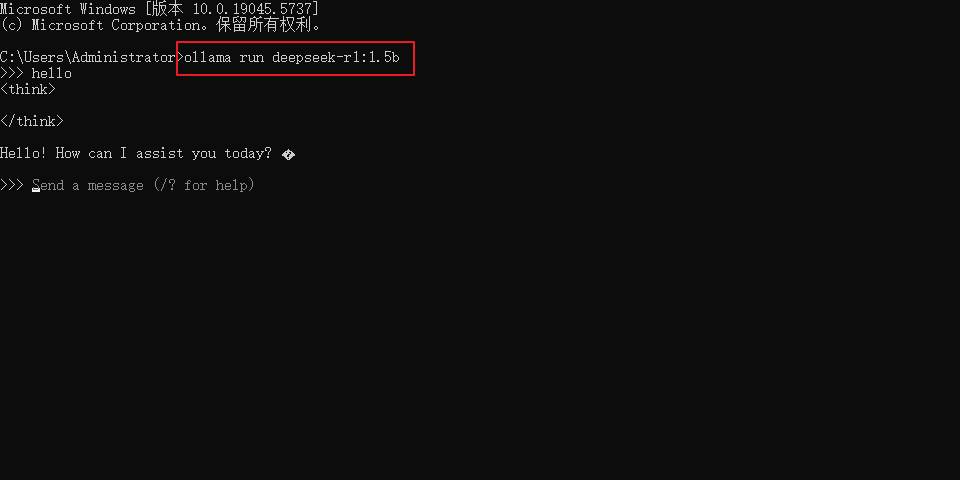

(3)执行命令:ollama run deepseek-r1:1.5b运行大模型。如果是第一次运行则会先下载大模型

ollama run deepseek-r1:1.5b

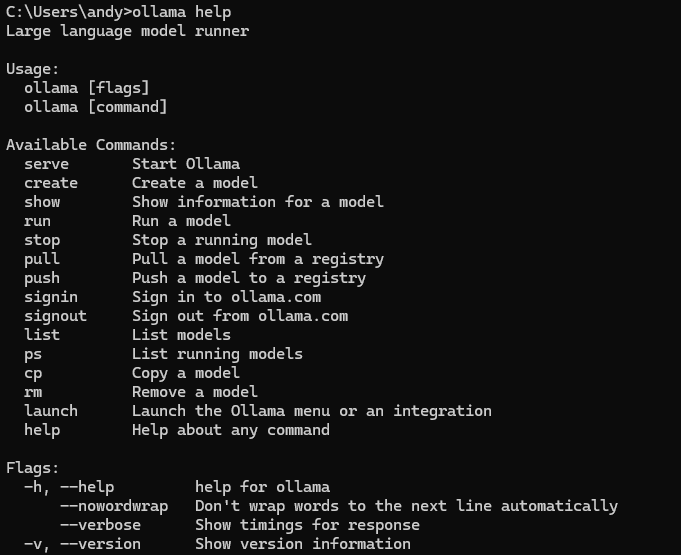

3.3、常用命令

ollama help

3.4、引入依赖

参考文档:https://docs.langchain4j.dev/integrations/language-models/ollama#get-started

<!-- 接入ollama -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-ollama-spring-boot-starter</artifactId>

</dependency>

3.5、配置模型参数

#ollama

langchain4j.ollama.chat-model.base-url=http://localhost:11434

langchain4j.ollama.chat-model.model-name=deepseek-r1:1.5b

# 创造性控制

# 0.7到1.2:适用于需要较高创造性的场景,如诗歌生成或头脑风暴

# 0.3到1.0:适用于需要较高稳定性和多样性的场景,如技术文档或法律文书的生成

langchain4j.ollama.chat-model.temperature=0.8

# 模型进行通信的超时时间为60秒。

langchain4j.ollama.chat-model.timeout=PT60S

langchain4j.ollama.chat-model.log-requests=true

langchain4j.ollama.chat-model.log-responses=true

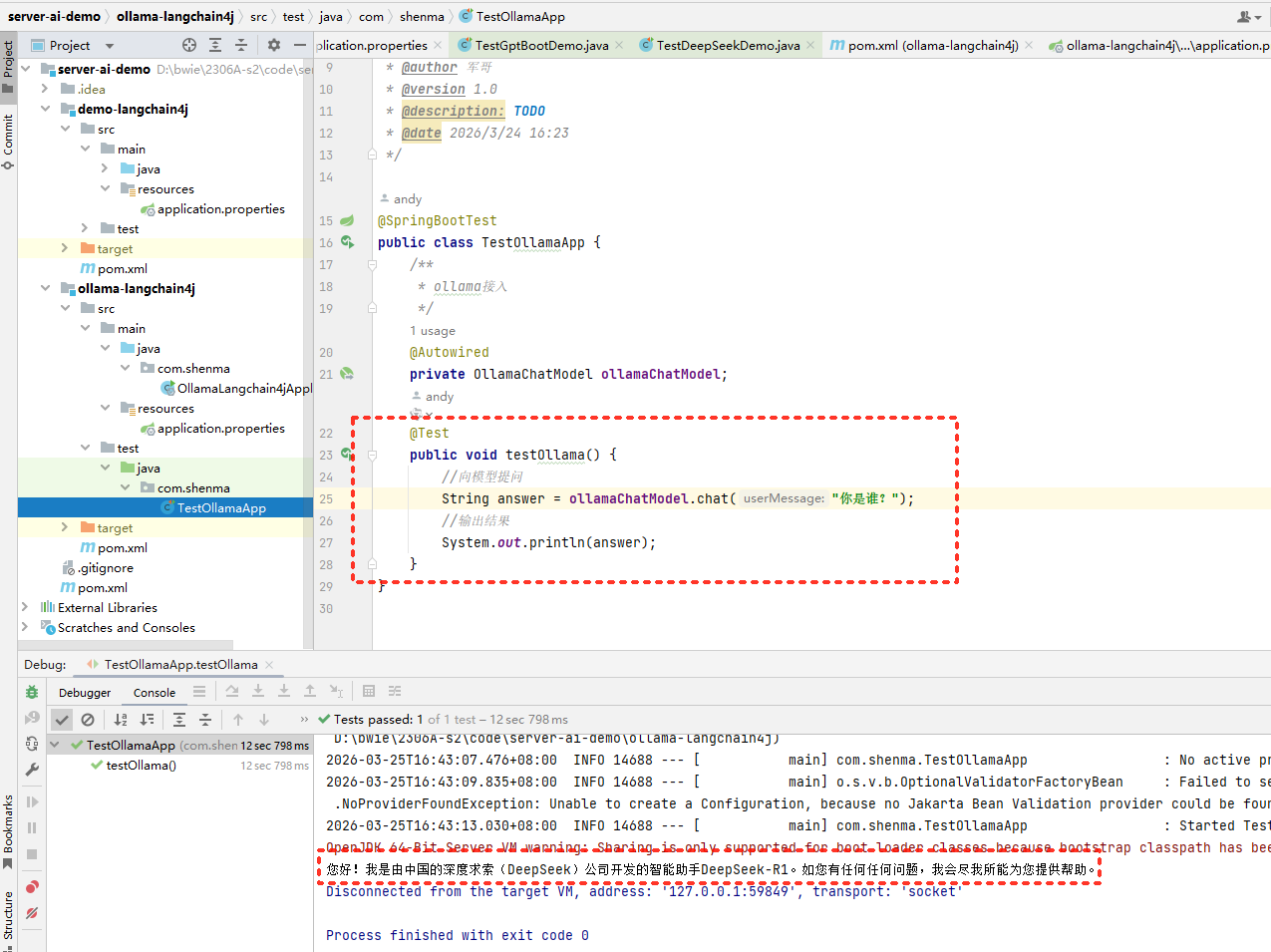

3.6、创建测试用例

/**

* ollama接入

*/

@Autowired

private OllamaChatModel ollamaChatModel;

@Test

public void testOllama() {

//向模型提问

String answer = ollamaChatModel.chat("你好");

//输出结果

System.out.println(answer);

}

4、接入阿里百炼平台

4.1、什么是阿里百炼

-

阿里云百炼是 2023 年 10 月推出的。它集成了阿里的通义系列大模型和第三方大模型,涵盖文本、图像、音视频等不同模态。

-

功能优势:集成超百款大模型 API,模型选择丰富;5-10 分钟就能低代码快速构建智能体,应用构建高效;提供全链路模型训练、评估工具及全套应用开发工具,模型服务多元;在线部署可按需扩缩容,新用户有千万 token 免费送,业务落地成本低。

- 模型广场:https://bailian.console.aliyun.com/?productCode=p_efm#/model-market

4.2、申请免费体验

(1)点击进入免费体验页面

(2)点击免费体验

(3)点击开通服务

(4)确认开通

4.3、配置apiKey

申请apiKey:https://bailian.console.aliyun.com/?apiKey=1&productCode=p_efm#/api-key

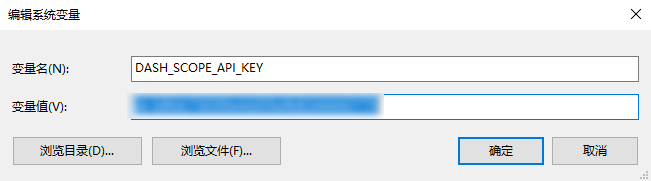

配置apiKey:配置在环境变量**DASH_SCOPE_API_KEY**中

4.4、添加依赖

LangChain4j参考文档:https://docs.langchain4j.dev/integrations/language-models/dashscope#plain-java

<dependencies>

<!-- 接入阿里云百炼平台 -->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-community-dashscope-spring-boot-starter</artifactId>

</dependency>

</dependencies>

<dependencyManagement>

<dependencies>

<!--引入百炼依赖管理清单-->

<dependency>

<groupId>dev.langchain4j</groupId>

<artifactId>langchain4j-community-bom</artifactId>

<version>${langchain4j.version}</version>

<type>pom</type>

<scope>import</scope>

</dependency>

</dependencies>

</dependencyManagement>

4.5、配置模型参数

#阿里百炼平台

langchain4j.community.dashscope.chat-model.api-key=${DASH_SCOPE_API_KEY}

langchain4j.community.dashscope.chat-model.model-name=qwen-max

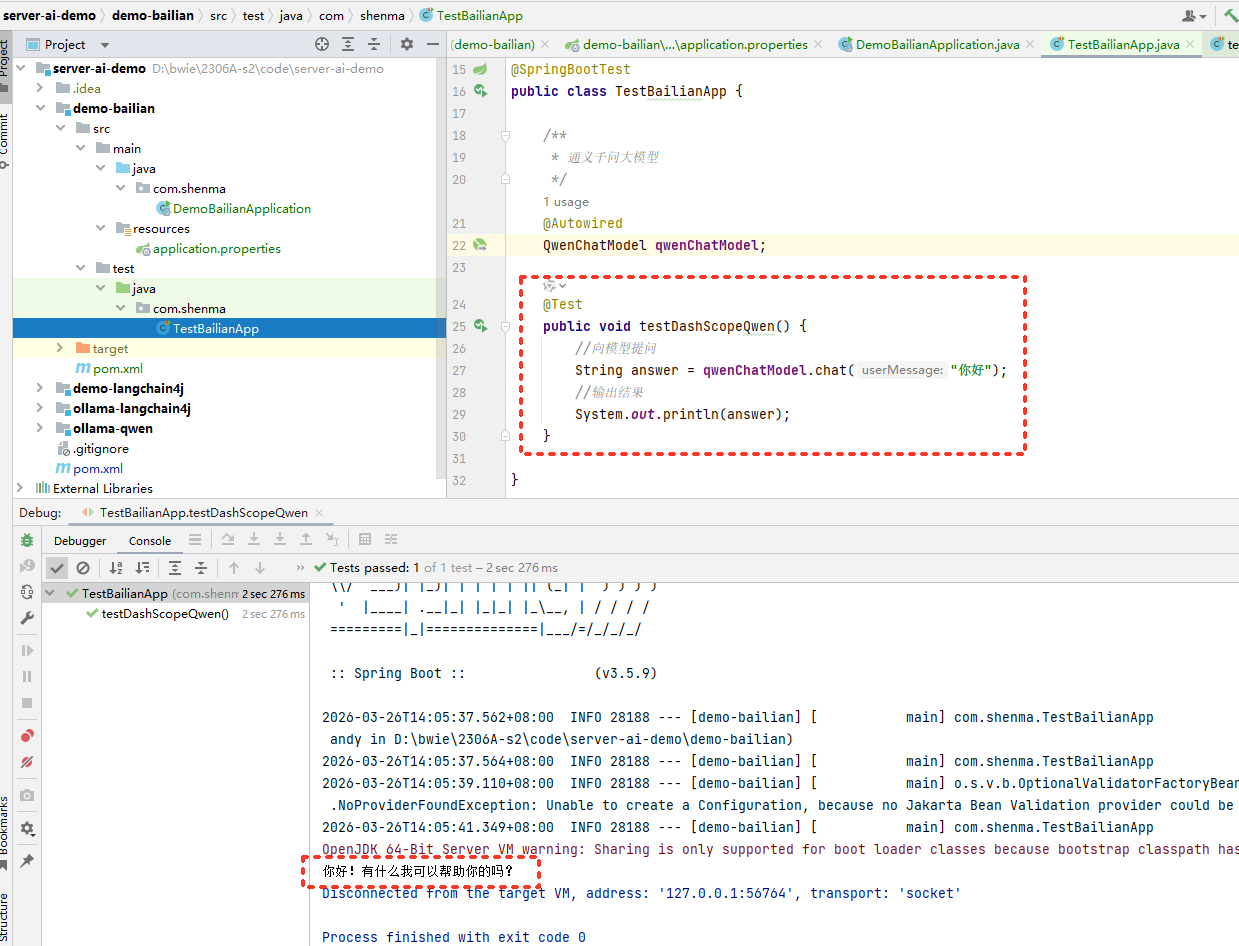

4.6、测试通义千问

/**

* 通义千问大模型

*/

@Autowired

private QwenChatModel qwenChatModel;

@Test

public void testDashScopeQwen() {

//向模型提问

String answer = qwenChatModel.chat("你好");

//输出结果

System.out.println(answer);

}

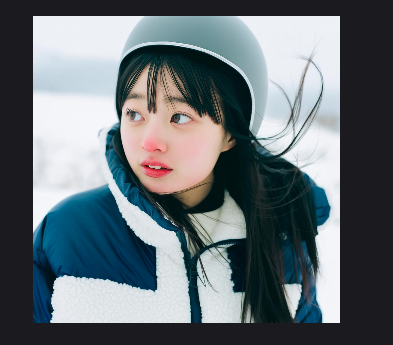

4.6、测试通义万相

生成图片测试

@Test

public void testDashScopeWanx(){

WanxImageModel wanxImageModel = WanxImageModel.builder()

.modelName("wanx2.1-t2i-plus")

.apiKey(System.getenv("DASH_SCOPE_API_KEY"))

.build();

Response<Image> response = wanxImageModel.generate("采用近景特写镜头拍摄的东亚年轻女性,呈现户外雪地场景。她体型纤瘦,呈站立姿势,身体微微向右侧倾斜,头部抬起看向画面上方,姿态自然放松。她的面部是典型东亚长相,肤色白皙,脸颊带有自然的红润感,五官清秀:眼睛是深棕色,眼型偏圆,眼神略带惊讶地望向上方,眼白部分可见;眉毛是深黑色,形状自然弯长;鼻子小巧挺直,嘴唇涂有红色口红,唇瓣微张,表情带着轻微的惊讶或好奇。她的头发是深黑色长直发,发丝被风吹得略显凌乱,部分垂在脸颊两侧,头顶佩戴一顶深灰色的头盔,头盔边缘露出少量发丝。服装是蓝白拼接的厚重外套,外套材质看起来是毛绒与布料结合,显得温暖厚实,适合雪地环境。背景是被白雪覆盖的户外场景,远处可见模糊的树木轮廓,天空是明亮的浅蓝色,带有少量白云,光线是强烈的自然日光,照亮人物面部与头发,形成清晰的光影,色调以蓝、白、黑为主,整体风格清新自然。画面顶部有黑色提示框,内有“www.shenmazong.com”的白色文字。镜头的近景视角放大了人物的表情与细节,营造出户外雪地的真实氛围。");

System.out.println(response.content().url());

}

上图中并没有包含文字,这是模型版本较低导致高版本的模型已经可以在照片上增加文字。

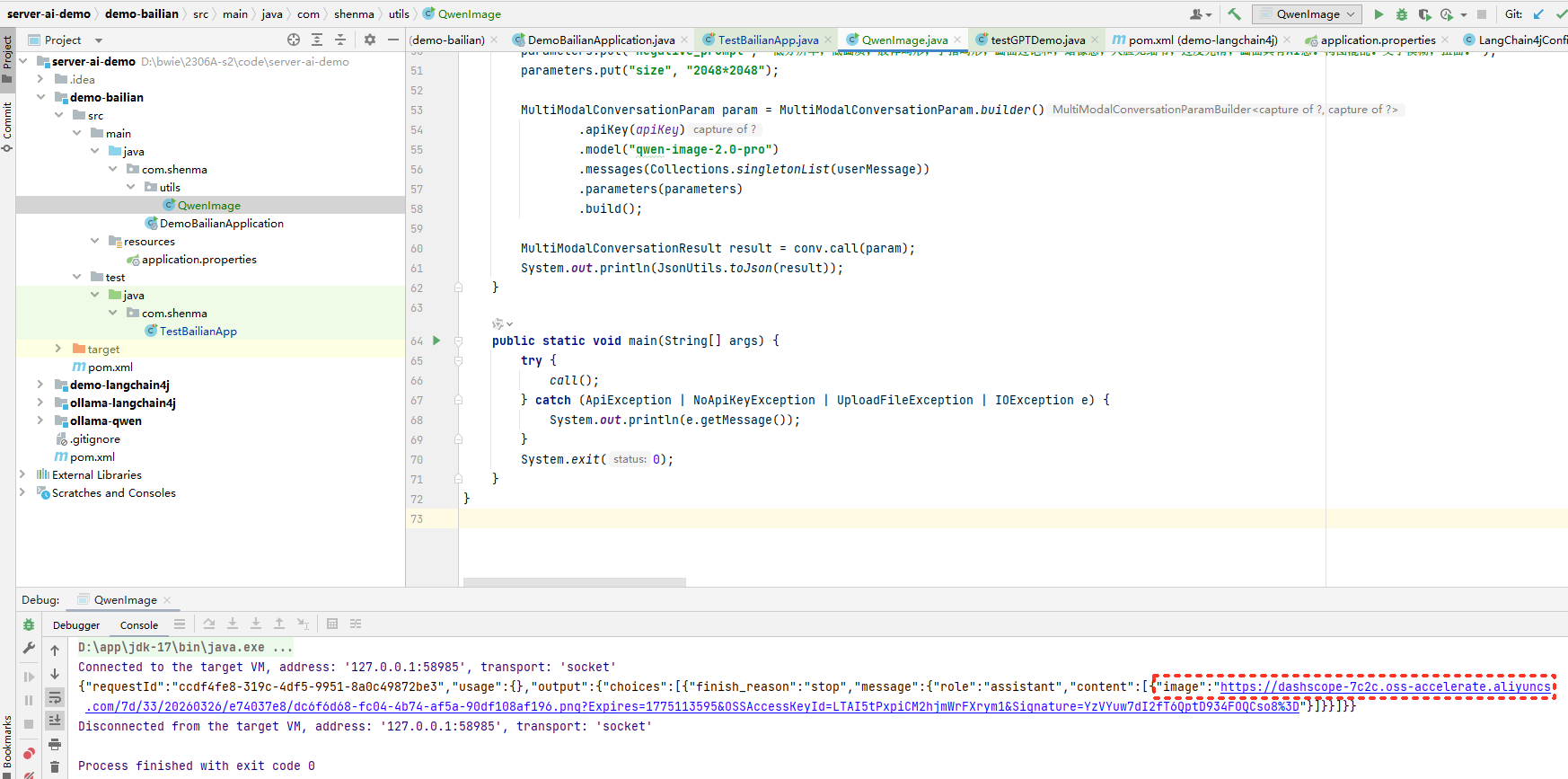

4.7、测试qwen-image-2.0-pro 文生图

package com.shenma.utils;

/**

* @author 军哥

* @version 1.0

* @description: TODO

* @date 2026/3/26 14:47

*/

import com.alibaba.dashscope.aigc.multimodalconversation.MultiModalConversation;

import com.alibaba.dashscope.aigc.multimodalconversation.MultiModalConversationParam;

import com.alibaba.dashscope.aigc.multimodalconversation.MultiModalConversationResult;

import com.alibaba.dashscope.common.MultiModalMessage;

import com.alibaba.dashscope.common.Role;

import com.alibaba.dashscope.exception.ApiException;

import com.alibaba.dashscope.exception.NoApiKeyException;

import com.alibaba.dashscope.exception.UploadFileException;

import com.alibaba.dashscope.utils.Constants;

import com.alibaba.dashscope.utils.JsonUtils;

import java.io.IOException;

import java.util.Arrays;

import java.util.Collections;

import java.util.HashMap;

import java.util.Map;

public class QwenImage {

static {

// 以下为北京地域url,若使用新加坡地域的模型,需将url替换为:https://dashscope-intl.aliyuncs.com/api/v1

Constants.baseHttpApiUrl = "https://dashscope.aliyuncs.com/api/v1";

}

// 新加坡和北京地域的API Key不同。获取API Key:https://help.aliyun.com/zh/model-studio/get-api-key

// 若没有配置环境变量,请用百炼API Key将下行替换为:static String apiKey ="sk-xxx"

static String apiKey = System.getenv("DASH_SCOPE_API_KEY");

public static void call() throws ApiException, NoApiKeyException, UploadFileException, IOException {

MultiModalConversation conv = new MultiModalConversation();

MultiModalMessage userMessage = MultiModalMessage.builder().role(Role.USER.getValue())

.content(Arrays.asList(

Collections.singletonMap("text", "冬日北京的都市街景,青灰瓦顶、朱红色外墙的两间相邻中式商铺比肩而立,檐下悬挂印有剪纸马的暖光灯笼,在阴天漫射光中投下柔和光晕,映照湿润鹅卵石路面泛起细腻反光。左侧为书法店:靛蓝色老旧的牌匾上以遒劲行书刻着“文字渲染”。店门口的玻璃上挂着一幅字,自上而下,用田英章硬笔写着“专业幻灯片 中英文海报 高级信息图”,落款印章为“1k token”朱砂印。店内的墙上,可以模糊的辨认有三幅竖排的书法作品,第一幅写着着“阿里巴巴”,第二幅写着“通义千问”,第三福写着“图像生成”。一位白发苍苍的老人背对着镜头观赏。右侧为花店,牌匾上以鲜花做成文字“真实质感”;店内多层花架陈列红玫瑰、粉洋牡丹和绿植,门上贴了一个圆形花边标识,标识上写着“2k resolution”,门口摆放了一个彩色霓虹灯,上面写着“细腻刻画 人物 自然 建筑”。两家店中间堆放了一个雪人,举了一老式小黑板,上面用粉笔字写着“Qwen-Image-2.0 正式发布”。街道左侧,年轻情侣依偎在一起,女孩是瘦脸,身穿米白色羊绒大衣,肉色光腿神器。女孩举着心形透明气球,气球印有白色的字:“生图编辑二合一”。里面有一个毛茸茸的卡皮巴拉玩偶。男孩身着剪裁合体的深灰色呢子外套,内搭浅色高领毛衣。街道右侧,一个后背上写着“更小模型,更快速度”的骑手疾驰而过。整条街光影交织、动静相宜。")

)).build();

Map<String, Object> parameters = new HashMap<>();

parameters.put("watermark", false);

parameters.put("prompt_extend", true);

parameters.put("negative_prompt", "低分辨率,低画质,肢体畸形,手指畸形,画面过饱和,蜡像感,人脸无细节,过度光滑,画面具有AI感。构图混乱。文字模糊,扭曲。");

parameters.put("size", "2048*2048");

MultiModalConversationParam param = MultiModalConversationParam.builder()

.apiKey(apiKey)

.model("qwen-image-2.0-pro")

.messages(Collections.singletonList(userMessage))

.parameters(parameters)

.build();

MultiModalConversationResult result = conv.call(param);

System.out.println(JsonUtils.toJson(result));

}

public static void main(String[] args) {

try {

call();

} catch (ApiException | NoApiKeyException | UploadFileException | IOException e) {

System.out.println(e.getMessage());

}

System.exit(0);

}

}

- 运行效果

- 生产图片的效果

参考的官网文档:

https://bailian.console.aliyun.com/cn-beijing?productCode=p_efm&tab=api#/api/?type=model&url=2975126

4.8、测试DeepSeek

也可以在阿里百炼上集成第三方大模型,如DeepSeek

将配置参数上的base-url参数指定到百炼平台,使用百炼上的大模型名称和apiKey即可

#集成百炼-deepseek

langchain4j.open-ai.chat-model.base-url=https://dashscope.aliyuncs.com/compatible-mode/v1

langchain4j.open-ai.chat-model.api-key=${DASH_SCOPE_API_KEY}

langchain4j.open-ai.chat-model.model-name=deepseek-v3

#温度系数:取值范围通常在 0 到 1 之间。值越高,模型的输出越随机、富有创造性;

# 值越低,输出越确定、保守。这里设置为 0.9,意味着模型会有一定的随机性,生成的回复可能会比较多样化。

langchain4j.open-ai.chat-model.temperature=0.9

使用之前的测试用例testSpringBoot测试即可